di Davide Cucciati

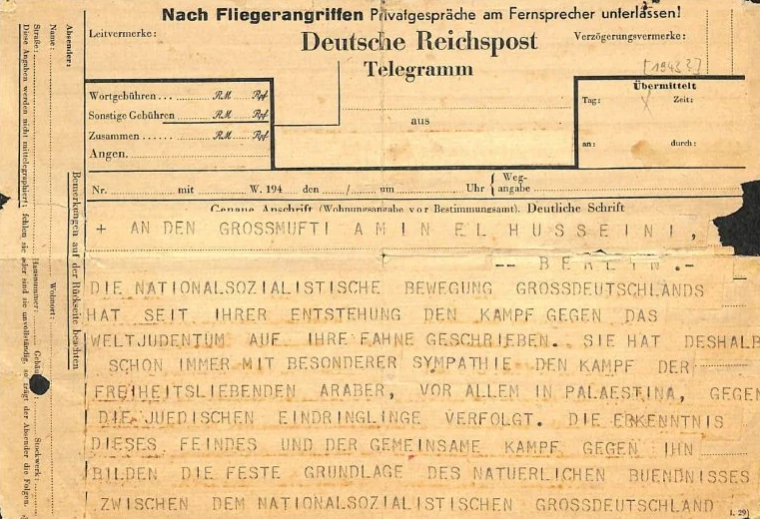

Il 13 marzo 2026 è stato reso noto che Meta ha rimosso il profilo personale Facebook di Romano dopo la pubblicazione di un contenuto che riportava un telegramma storico inviato da Heinrich Himmler al Gran Muftì di Gerusalemme Amin al-Husseini. Segnalazioni organizzate?

Per anni abbiamo pensato che i social network fossero un allargamento naturale della libertà di espressione. In parte lo sono stati. Ma, nello stesso tempo, abbiamo tutti partecipato, chi più chi meno, a un processo che ha indebolito i luoghi classici della mediazione pubblica: i giornali, le sedi editoriali riconoscibili, i tempi più lenti della verifica e della riflessione. Abbiamo preferito la velocità, l’impatto immediato, la reazione istantanea. Così, poco alla volta, una parte crescente del dibattito pubblico si è spostata su piattaforme private che non nascono per garantire il pluralismo o la profondità del confronto, ma per organizzare flussi, visibilità e interazioni.

Anche per questo il caso di Davide Romano non è solo un incidente individuale: è il sintomo di un problema più ampio. Meta stessa ha ammesso, il 7 gennaio 2025, di avere censurato troppo contenuto innocuo e di avere commesso troppi errori di enforcement, parlando di una riduzione successiva degli errori negli Stati Uniti ma riconoscendo implicitamente che il problema era reale.

Il caso Davide Romano

Davide Romano, direttore del Museo della Brigata Ebraica di Milano, è una figura pubblica molto esposta nel dibattito su memoria storica, antisemitismo e Israele. Il 13 marzo 2026 è stato reso noto che Meta ha rimosso il suo profilo personale Facebook dopo la pubblicazione di un contenuto che riportava un telegramma storico inviato da Heinrich Himmler al Gran Muftì di Gerusalemme Amin al-Husseini.

Il contenuto contestato era presentato come un documento storico: è questo che rende il caso particolarmente rivelatore. Le dichiarazioni di Romano a Mosaico aiutano a mettere a fuoco il nodo vero. “Sono convinto anche io che ci sia dietro una storia di segnalazioni organizzate. Ma il punto non è quello. La questione vera è perché i controlli da parte di Meta siano falliti”.

La sua osservazione è più solida di una lamentela generica sulle segnalazioni di massa. Anche ammesso che vi siano state segnalazioni coordinate, resta da capire perché Meta ha trattato come problematico un contenuto di natura documentaria. In questo senso il problema è la qualità del giudizio esercitato dalla piattaforma. Il problema è la combinazione tra pressioni esterne, automazione imperfetta, controlli umani non sempre adeguati e rimedi successivi spesso deboli.

Il nodo vero

Qui, però, va aggiunto un punto decisivo: il problema non riguarda soltanto gli ebrei o i sostenitori di Israele. Anche il fronte propal, da anni, denuncia rimozioni, limitazioni e soppressioni di contenuti. Nel dicembre 2023 Human Rights Watch ha parlato apertamente di “censura sistematica” di contenuti favorevoli alla Palestina su Facebook e Instagram, documentando oltre 1.050 casi di oscuramento o di soppressione tra ottobre e novembre 2023, quasi tutti relativi a contenuti pacifici in sostegno della causa palestinese. Questo dato non smentisce la denuncia che oggi proviene dal mondo ebraico. La rafforza, perché mostra che il problema è strutturale: siamo dentro uno spazio che si presenta come luogo del discorso pubblico ma che continua a funzionare secondo logiche proprietarie e tecniche che producono compressioni intermittenti, difficili da prevedere nei loro effetti e spesso sproporzionate.

Come funziona, in concreto, la moderazione

In termini molto semplici, il percorso è questo: un contenuto può essere segnalato dagli utenti tramite gli strumenti interni della piattaforma ma può anche essere intercettato prima ancora di qualsiasi segnalazione dai sistemi automatici di Meta. Successivamente, intervengono ulteriori livelli di valutazione, che possono coinvolgere sia strumenti automatici sia revisori umani, a seconda del tipo di contenuto e della policy coinvolta. Se la piattaforma ritiene che vi sia una violazione, può limitare il contenuto, rimuoverlo o adottare misure sull’account. L’utente può poi contestare la decisione attraverso i meccanismi interni di riesame e, in alcuni casi, arrivare fino all’Oversight Board, organismo indipendente istituito per riesaminare una quota molto limitata di ricorsi e di casi rinviati dalla stessa Meta.

Il precedente CasaPound

In Italia il precedente più interessante, proprio per capire la portata sistemica della questione, resta quello di CasaPound. Il 9 settembre 2019 Facebook rimosse la pagina del movimento d’estrema destra e il profilo del suo amministratore. In sede cautelare, il Tribunale di Roma ordinò la riattivazione. In quella fase, i giudici scrissero che Facebook aveva assunto un “preminente e rilevante ruolo” nell’ambito dei social network, “e quindi oggettivamente anche per la partecipazione al dibattito politico”, aggiungendo che la disponibilità in internet di altri strumenti di comunicazione “non si può reputare sufficiente ad escludere la gravità del pregiudizio”.

Quando una piattaforma privata diventa infrastruttura centrale della discussione pubblica, il suo potere di esclusione non è più neutro sul piano democratico. La vicenda CasaPound, però, è utile proprio perché non offre una morale facile. Nel giudizio di merito, nel 2022, il Tribunale di Roma ha rovesciato l’esito cautelare e ha riconosciuto a Meta il diritto di rimuovere la pagina, ritenendo legittima la designazione di CasaPound come organizzazione che incita all’odio e valorizzando il contenuto delle policy contrattuali di Facebook. Conseguentemente, il tema è questo: se il potere di moderazione esiste ed è in certi casi legittimo, allora diventano decisivi i criteri, la proporzione, la prevedibilità delle decisioni e la qualità delle garanzie offerte a chi viene colpito.

La specificità ebraica

Per gli ebrei italiani, però, il problema assume un peso ulteriore. Romano osserva che ormai molti eventi ebraici in presenza vengono limitati o scoraggiati per ragioni di sicurezza, che l’esposizione pubblica nelle università è spesso conflittuale e che in televisione, a suo avviso, trovano spazio soprattutto voci ebraiche considerate più accettabili dal sistema mediatico. Se una minoranza sperimenta già una riduzione di agibilità nello spazio fisico, allora la perdita di agibilità nello spazio digitale pesa di più.

Il nodo degli insulti antisemiti

C’è poi il capitolo degli insulti antisemiti che restano online. La spiegazione più seria non è partire subito dall’idea di una volontà sistematica di proteggere l’odio antiebraico. Potrebbe esserci anche una causa più semplice e più strutturale: molti di quei contenuti non vengono segnalati o non vengono segnalati in modo efficace. Questo punto trova un riscontro importante nel Handbook on Online Antisemitism, pubblicato dalla Commissione europea il 26 febbraio 2026, che insiste sul ruolo del reporting, dei segnalatori attendibili e sull’idea che più contenuti antisemiti vengono segnalati, meglio le piattaforme possono addestrare i propri sistemi a riconoscerli. In altre parole, una parte del problema può davvero essere una sotto-segnalazione cronica.

Tutti abbiamo contribuito a creare questo sistema

Il problema non è solo “nostro” e dei casi già documentati qui su Mosaico (Elena Lea Bartolini, il Comitato Setteottobre guidato da Stefano Parisi, Michael Sfaradi e Ciro Principe). Abbiamo contribuito tutti, in anni di entusiasmo acritico per il digitale, a svalutare i giornali, la responsabilità editoriale, i tempi più lenti della verifica. Abbiamo trattato la comunicazione immediata come se fosse automaticamente più democratica. Abbiamo assistito a giornalisti che diventavano attivisti, influencer che pretendevano di fare gli analisti e figure nate per altri linguaggi che hanno occupato lo spazio dell’informazione. Oggi vediamo una discussione pubblica sempre più dipendente da piattaforme private, da meccanismi di ranking e moderazione che nessun cittadino ha davvero contribuito a scrivere e che nessun elettore può davvero sanzionare in senso politico.